Россия

Россия

Россия

Рассматриваются проблемы, сопряженные с использованием искусственного интеллекта в системе управления безопасностью мореплавания, затрагивающие научные, философские, психологические, правовые, технические, эксплуатационные и другие аспекты, образовавшиеся в связи со стремительным проникновением искусственного интеллекта в морские технологии. В настоящее время морские автономные надводные суда (МАНС) целого ряда зарубежных стран (Китай, Япония, Дания, Швеция, США и др.) уже совершают опытную эксплуатацию в прибрежных районах Мирового океана. В России также под государственным надзором ведутся научные исследования и проводятся опытные рейсы на судах различного типа и оснащения. Возникающие проблемы внедрения искусственного интеллекта на морские суда весьма неоднозначны и очень рискованны, поскольку затрагивают проблемы всего человечества (95 % мировой торговли осуществляется через океан). Предотвращение угроз для макросистемы «морская среда – судно – груз – человек» невозможно решать без комплексного, системного подхода. Все связи внутри системы и вне ее нельзя осуществлять без наработки целого пакета взаимосвязанных нормативно-правовых актов, как национальных, так и международных. Комплекс положений и документов международной морской организации направлен на общеизвестные морские суда, соблюдение их при эксплуатации в море МАНС не должно нарушать установленные закономерности. Особенно принципиально должны решаться проблемы, связанные с ответственностью на всех уровнях, как во внутренних водах, так и в открытом море. Дано определение понятия искусственного интеллекта и отражены проблемы: создания бортовых интеллектуальных систем, интеграции особенностей искусственного интеллекта с природным потенциалом человеческого интеллекта и использования искусственного разума, реализации мировых целей и решения насущных проблем человечества и прогнозирования предотвращения угроз для системы в будущем.

искусственный интеллект, бортовые интеллектуальные системы, безопасность мореплавания, интеллектуальная интенсификация, когнитивное моделирование, коэффициенты безопасности, антропогенные предикторы

Введение

Основными элементами системы управления безопасностью мореплавания (макросистемы) являются, во-первых, человек (человеческий элемент – ЧЭ), во-вторых, судно как транспортное средство, груз как предмет для транспортировки, в-третьих, условия окружающей среды – морское и воздушное пространство. Образуя комплекс макросистемы, оказывая влияние на характер ее деятельности, каждый из названных элементов имеет свои специфичные черты, точки и рычаги взаимодействия и может быть рассмотрен в качестве самостоятельной подсистемы.

Первостепенным и значимым элементом, находящимся на вершине холархии макроса, безусловно, является ЧЭ. В процессе управления судном он подчиняет себе первые две подсистемы, преодолевает третью, учитывает их взаимное влияние друг на друга и координирует свою деятельность.

Управление судном представляет собой информационный процесс, поэтому важное значение имеет количество, своевременность и достоверность информации. Результатом процесса переработки информации является принятое решение. Судоводителю часто приходится принимать алгоритмические решения, обоснование которых производится по определенным установленным правилам – алгоритмам, основанным на строгой формализации, или эвристические, выполнение которых основывается не на формальном, а на творческом методе без каких-либо установленных правил [1].

В зависимости от наличия и характера исходной информации судоводитель вынужден принимать решение в условиях определенности (полная информация) или в условиях неопределенности (неполная информация или ее отсутствие). В силу субъективного характера самого акта принятия решения невозможно установить для него единые и строгие правила. Основную роль в процессе принятия решения играют опыт, личные способности и умение предвидеть развитие событий.

Существенное влияние оказывают консциентальные предикторы. Нередким явлением в опасных условиях, ведущих к аварийным ситуациям, становится психологический стресс. И члены судового экипажа, будучи квалифицированными специалистами, могут допустить погрешность – принять неверное решение. Таким образом, можно прийти к выводу о том, что ни один из элементов судна или его подсистем не обладают достаточной надежностью.

Материалы исследования

Анализ причин и следствий столкновений, повреждений судов, аварийных несчастных случаев в море подтверждает эпизодический, акцидентный характер их возникновения [1].

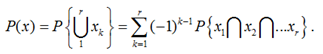

Рассматривая патогенез событий как несистемный, случайный, можем прийти к определенному выводу, если принять, что

![]()

где Е – инциденты в море, возникшие из-за технических неисправностей; Н – инциденты, возникшие из-за инспирированных предикторов, а ![]() и

и ![]() – множество инцидентов.

– множество инцидентов.

Инциденты Ei возникают в ходе инженерных разработок, во время производства или эксплуатации по дискурсивным моделям «И», «ИЛИ», «m из n». Порождение инцидентов Hj складывается по принципу «домино» или появляется как следствие ряда происшествий, возникших по названным выше схематическим моделям [1].

Одна и та же кинестетическая выраженность происшествий может быть спровоцирована дифференциальными вариативными факторами.

Объективная возможность (вероятность) инцидентов P(E) и P(H) в общем виде констатируется как

.

.

Допустимость инцидентов F отражает импликативную вероятность

Так как P(E) > 0, P(H) > 0, то вероятность инцидента P(F) > 0, что указывает на тот факт, что разработать гарантированную надежную систему с нулевой вероятностью инцидентов невозможно, т. е. абсолютной безопасности нет [2].

Создание бортовых интеллектуальных комплексов (ИК) – сложная и трудно формализуемая задача, а применение методов искусственного интеллекта в бортовых ИК для ее решения сопряжено с необходимостью учета сложнейших процессов, таких как [1]:

- компликация и квинтэссенция, неопределенность и недостаточность исходной информации;

- подвижность предмета внимания как проблемы, отсутствие времени на поиск решений;

- преобразование экзогенной среды и характеристик плавучего объекта;

- влияние ЧЭ.

И при таком подходе на разработку ИК проявляется первая проблема - общепринятого понятия «искусственный интеллект» нет.

Первая попытка дать определение искусственному интеллекту принадлежит Дж. Маккарти. По его мнению, искусственный интеллект – это:

- способность конвенциональных высокоинтеллектуальных систем совершать уникальные мыслительные операции, которые ортодоксально присущи исключительно человеку (не связывать с искусственным сознанием);

- научные парадигмы и методы разработки, конструирование интеллектуальных инженерных комплексов, интеллектуальных компьютерных программ (время появления первых компьютеров).

Прошло более чем полвека, и вот современная наука уже рассматривает другое суждение, которое заключается в том, что интеллект является биологическим уникальным явлением.

Ученые лингвисты переводят слово intelligence как «умение рассуждать разумно», одновременно подчеркивают, что в английском языке слово «интеллект» имеет свой эквивалентный вариант – intellect. Соответственно, словосочетание artificial intelligence не несет антропоморфных признаков, присущих слову «интеллект», речь идет о сознательных логических мыслительных операциях [3].

В деятельности ЧЭ вынужден предусматривать появление непредвиденных явлений, окказиональных действий членов судового экипажа, которые могут возникать на уровне социальных коммуникаций. Принятие решения судоводителем является своеобразным декларативным предохранительным механизмом, оберегающим коллектив экипажа от «взрыва» на уровне сотрудничества и общения, опрометчивых поступков, неумышленных непрофессиональных действий. Искусственный интеллект эти моменты может не только не учесть, но и не выявить вовсе [4, 5].

Мышление ЧЭ - интеллектуальная интенсификация. Под мышлением может пониматься только ее активная дифференциальная мыслительная часть.

Интеллектуальная интенсификация ЧЭ - это любая работа, связанная с изменением информации, ее интроспективная формация, поэтому слово «информация» детерминировать сложно. В настоящей работе достаточно толковать термин «информация» как некоторое состояние и возможное изменение физического мира, на основании которых ЧЭ получает данные (информационные сообщения), касающиеся не лично ЧЭ, а окружения или чего-то другого [4].

Кто (ЧЭ или ИК) и как способен эти сообщения считывать, обрабатывать и применять? Этот парадокс выступает в качестве доминантного. Возможность считывать в одном моменте доказательства других признаков и есть, по сути, манипуляция, восстанавливающая информацию. Исходные данные не являются информацией, они означают некоторое состояние физического мира, пока не окажутся востребованными для кого-то [3, 4].

Таким образом, определена вторая проблема создания бортовых ИК, особенно актуальная для безопасности системы «морская среда – судно – груз – ЧЭ».

В некоторых документах литературных российских и зарубежных источников даны формулировки искусственного интеллекта, фиксирующие спецификацию использования данного феномена в разных сферах деятельности – финансовых операциях в бизнесе, диагностирование в медицине, наложение оркестровых фонов в музыке, пределы компетенции в правовых вопросах юрисдикции, эмпирически проверяемые и подтверждаемые знания в науке, расширение возможностей технических средств и технологий для создания материальных ценностей и т. д.

Сформулированы определения понятия «искусственный интеллект», которые раскрывают его с разных сторон [3, 5, 6]:

- вектор науки, в контексте которого определяются и рассчитываются задачи создания программных моделей форм человеческой активности, которые ортодоксально принято относить к интеллектуальным;

- качество высокоинтеллектуальных систем осуществлять уникальную (творческую) деятельность, которая всегда являлась преимуществом человека (высокоинтеллектуальная система обладает внутренними резервами знаний в определенной предметной области, хранящимися в памяти, и функциями раскрытия этих знаний при необходимости);

- предметный курс в информатике или информационных технологиях, который предполагает воспроизведение мыслительных операций с помощью вычислительных программ специального оборудования;

- потенциал и восприимчивость системы точно трактовать и комментировать кинестетическую информацию, давать показания и рекомендации для дальнейшего использования.

Если учитывать общие детерминанты для человека и программного вычислительного оборудования, можно дать следующее определение понятию «интеллект»: это ресурс системы генерировать образовательные тренировочные программы с повышенной сложностью, предлагать и демонстрировать возможные способы и варианты решения.

Третья проблема является следствием первых двух. В науке нет четкого определения, в какой именно области наиболее востребован искусственный интеллект. Каждый из авторов-ученых, опираясь на свое толкование понятия, рассматривает его в свете свершений определенной научной доктрины.

В философии также открыт вопрос о природе и статусе интеллекта человека. Нет доказательства «разумности» искусственного интеллекта. В первоначальных источниках, посвященных данной проблеме, были выдвинуты разные гипотезы. Несмотря на разные комбинации представления задач и комбинационных схем искусственного интеллекта, сверхинтеллектуальная информационная система так и не создана [3, 5, 6].

Первым из исследователей, предложивших логичные критерии для выявления результативности искусственного интеллекта, стал А. Тьюринг. Предложенный ученым эмпирический тест помогает детерминировать потенциал и особенности искусственного мышления, близкого к мышлению человека. Один человек взаимодействует с компьютером. На основании ответов компьютера человек должен определить, с кем он общается: с человеком или компьютером. Задача компьютера - введя человека в заблуждение, заставить его сделать неверный выбор [6].

Современные писатели-фантасты публикуют навязчивую мысль: искусственный интеллект сформируется близким к человеческому только в случае, если машина научится чувствовать и творить. Однако это не мешает развиваться и другим потенциальным вариантам: логический, агентно-ориентиро-ванный, гибридный, работа с естественными языками, биологическое моделирование искусственного интеллекта, робототехника, машинное творчество и другие области исследований [3, 7].

Далее рассмотрим четвертую проблему внедрения технологий искусственного интеллекта.

В XXI в. становятся эманированными два вектора формирования искусственного интеллекта [7]:

- интеграция преимущественных особенностей искусственного интеллекта с природным потенциалом человеческого интеллекта;

- использование созданного на интегральной основе искусственного разума для реализации мировых целей и решения проблем человечества.

Ведущая роль отведена науке когнитологии, которая не только изучает процессы аккумуляции и ассимиляции, воссоздания и использования информации, но и объединяет другие науки, заставляя их работать на себя, – нейрофизиологию, эпистемологию, психологию (когнитивную) [5, 7].

Методология когнитивного моделирования, предложенная Р. Аксельродом, в настоящее время прогрессирует в направлении совершенствования аппарата анализа, моделирования ситуации, вариантов прогнозов развития ситуации и методов решения обратных задач.

Совершенно по-другому звучит тема «Создание искусственного разума» у философов. Представители одной группы ученых борются за открытие искусственного интеллекта, работают над точным определением самого понятия, предвкушая возможности, которые откроются перед человечеством. Другая группа ученых акцентирует внимание на моменте, касающемся будущего: для них важна консеквенция открытия [3, 7].

Несмотря на противоречивые высказывания насчет рисков и последствий, мнения ученых однозначны в вопросе необходимости создания искусственного интеллекта. Представители течения трансгуманизма относят этот вопрос к задачам первостепенной важности [3, 8–10].

Различные гипотезы были выдвинуты и нашли свое подтверждение в применении искусственного интеллекта в той или иной области. Однако к созданию искусственного разума ни одна исследовательская группа пока так и не подошла, несмотря на полученные результаты: разработка IBM Watson, способная воспринимать человеческую речь и производить вероятностный поиск; одна из экспертных разработок MYCIN, которая могла диагностировать небольшой набор заболеваний, причем часто так же точно, как и доктора; система распознавания речи Via Voice; система Midjourney, генерирующая изображения на основе текстовых запросов [8–10].

К наиболее известным в области искусственного интеллекта можно отнести системы компьютерных игр: шахматная программа разработки IBM победила чемпиона мира по шахматам; программа игры «Го» разработки DeepMind выиграла матч у корейского профессионала девятого дана Ли Седоля [8, 9].

Наиболее крупные научные и исследовательские центры в области искусственного интеллекта находятся в России, Индии, США, Германии и Японии (Научный совет по методологии искусственного интеллекта РАН, Индийский технологический институт в Мадрасе, Массачусетский технологический институт машинного интеллекта, Немецкий исследовательский центр по искусственному интеллекту и Национальный институт передовой промышленной науки и технологий Японии) [3, 9].

Пятая проблема обусловлена тем, что безопасность мореплавания, как и безопасность других структурно сложных объектов и макросистем, должна решаться в определенной последовательности этапов, охватывающих стадии проектирования, производства и эксплуатации. Временной период для вхождения искусственного интеллекта в реальность для таких объектов и макросистем не определен, поскольку все составляющие стадии весьма инерционны [9, 10].

Например, традиционные методы расчетов на прочность, базирующиеся на концепции коэффициентов безопасности (например, коэффициенты запаса по пределу текучести и пределу прочности), позволяют установить предельные уровни допускаемых в эксплуатации усилий, напряжений и деформаций. Для обоснованности назначения ресурсных характеристик используют методы расчета на мало- и многоцикловую усталость в детерминированной и вероятностной трактовках [7, 11–15].

Потребность формируемой теории риска характеризуется переходом от доминирующей ранее концепции коэффициентов безопасности к концепции приемлемого риска (характерно для РФ только в XXI в.).

Перейдем к шестой проблеме. Чтобы предотвращать угрозы, необходимо научиться прогнозировать будущее. Прогнозы для развития глобальных проблем невозможны в рамках одного направления науки. Когда речь идет о безопасности человека, важными становятся междисциплинарные подходы. Они играют роль своеобразной системной интеграции отраслей науки, помогают взглянуть на проблему в целом. Поэтому необходимо, чтобы создаваемая сейчас теория риска и управления безопасностью разрабатывалась на основе достижений искусственного интеллекта и стала широким обобщающим междисциплинарным подходом (философия, экология, кибернетика, синергетика, когнитивная психология и другие науки), способным играть важную роль в выборе алгоритма развития человеческой организации [9, 10].

Авторами предлагается один из возможных теоретических подходов к разработке основополагающих принципов теории риска и управления безопасностью (в том числе и на море), в основе которого лежат [16–19], во-первых, законы энергоинформационного полевого взаимодействия между объектами и субъектами систем различного порядка и сложности, во-вторых, как субъект и объект безопасности человек присутствует во всех ее системах, играя в них при этом основную, системообразующую или негативную роль. Человек - результат опасностей, человек - источник опасностей, и человек - основа безопасности своей, социума и Земли. Поэтому основным постулатом выдвигается антропоцентрический принцип, исходящий из насущной потребности человека в безопасности. Нет человека, и никому не нужна безопасность [18]. В-третьих, если полагать, что обеспечение безопасности человека является основным критерием всех аспектов безопасности в системах всех форм и на любых уровнях, то решение проблемы предлагается на принципах самоорганизации старших по иерархии систем, где невозможно установление жесткого контроля за системой. Управление такой системой может рассматриваться лишь как способствование собственным тенденциям развития системы с учетом присущих ей элементов саморегуляции. Ядром такой системы является триада «Природа – Человек – Общество». Центральной компонентой полной функции управления является ЧЭ, опирающийся в своей деятельности на искусственный интеллект, ограниченный функцией безвредности по отношению к нему. Подсистемами будут являться интеллектуальные комплексы любого уровня, подчиненные и обслуживающие основную триаду [17].

В совокупности все изложенные выше принципы обеспечат решение одной из важнейших проблем человечества, которая является целью общей теории риска и безопасности - проблему экологической безопасности [20–22].

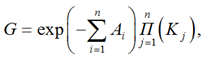

Рассмотрим математическую модель [23], которая дает возможность предусмотреть объединение многих биологических параметров и физических особенностей среды в создании экологических условий для существования человека (во времени), определяемых через нормированную функцию G и представляющую собой этот запас жизнедеятельности. Авторы [23] предлагают использовать ее в качестве основы для запрещающего надзора над действиями искусственного интеллекта в системах управления безопасностью, в случае возникновения угрозы для существования человека со стороны искусственного интеллекта:

где Аi – функции природных и антропогенных предикторов, оказывающих воздействие на резервы жизнедеятельности, но не располагающих определением наибольшей величины для благоприятных условий существования, имеет отличительную черту в диапазоне исследуемых (возможных) значений только лимитирующим фактором (уровнем, дозой и т. д.); Kj – функции природных и антропогенных предикторов, оказывающих воздействие на резервы жизнедеятельности, располагающие определением наибольшей величины для благоприятных условий, называемые «зонами комфорта»; G – общепринятая функция с уровнем нормы (сфера константного существования устанавливается неравенством Gmin < G £ 1), фиксирующая резерв жизнедеятельности.

Некоторые функции вида Аi представлены ниже [23]:

![]()

где αi – весовой множитель i-го фактора, величина множителя обусловлена временем воздействия фактора; fi – нормированный фактор (fi = Фi / ФПДК, где Фi и ФПДК – измеренное и предельно допустимое значения i-го фактора).

Факторы, вредно воздействующие на организм человека: теплового излучения fт, светового излучения fc, задымленности fз, шумности fш, действия электрического тока fэл, действия электрического напряжения fн, действия электромагнитных полей fп, некоторых сильнодействующих ядовитых газообразных веществ при различных концентрациях и экспозициях fяв, воздействия проникающей радиации fр, отморожения fот и др.

Перечисленные выше факторы не охватывают, безусловно, всей совокупности опасных влияний на организм человека, они лишь дают информацию об их многообразии и степени воздействия на общий запас жизнедеятельности (в некоторых источниках количество вредных факторов больше 30).

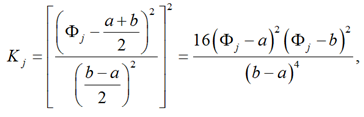

Некоторые функции вида Kj [23]:

где Фj - фактор; a и b - пределы терпимости организма человека к данному фактору.

Как правило, факторы Фj определяют наиболее благоприятные условия существования человека или так называемые «комфортные зоны»: температура – 20–25 °С при относительной влажности 50–70 %; атмосферное давление – 101,3 кПа (760 мм рт. ст.); освещенность – порядка 250–300 лк и многие другие параметры.

В этом случае проблемы безопасности человека и защиты окружающей среды будут определять экономическое и научно-техническое развитие современной цивилизации. Системы управления безопасностью, подчиненные основной триаде, будут обеспечивать безопасность не только мореплавания, всецело реализуя в себе основные принципы предлагаемого подхода на основе искусственного интеллекта.

Анализ полученных данных теста А. Тьюринга не убеждает в наличии факта, что машина может являться носителем процесса мышления. Подтверждает это и мысленный эксперимент Дж. Сёрля под названием «Китайская комната». В книге «Новый ум короля» Р. Пенроуз констатирует, что номинативные искусственные системы не могут дать живого процесса мышления [21].

В 2018 г. М. Хатсон в статье журнала Science отмечает, что проблема открытия искусственного интеллекта заключается в отсутствии возможности воспроизвести результаты. Данные рецензентов закрыты кодами, которые согласно утвержденной практике невозможно вскрыть, соответственно, невозможно диагностировать и делать выводы насчет «успехов» искусственного интеллекта [21].

Профессор Е. Юдковски (SIAI, США) предупреждает о тотальных проблемах в случае пренебрежения опасностью, к которой может привести взаимодействие человечества с искусственным интеллектом; подчеркивает важность программирования «нового сознания» на приоритетное отношение к человеку [21].

В 2004 г. общественности США было предложено высказать мнение о решении проблем, поднятых в фильме «Я, робот». Речь шла об этике использования искусственного интеллекта. Обсуждалась идея того, что законы робототехники Азимова как игра с жизнью и смертью: не понимая человеческих чувств и ощущений, искусственный интеллект может в благих целях – защиты от вреда - отстранить людей от власти на Земле, установив свои законы [21].

С внедрением в жизнь искусственного интеллекта возникают и правовые вопросы. Уже сегодня они становятся насущными. Например, кто будет нести ответственность и какую ответственность при столкновениях, авариях и прочих коллизиях на море с морскими автономными судами, управляемыми ИК на базе искусственного интеллекта [24–26].

Заключение

Ключевыми составляющими системы управления безопасностью мореплавания являются ЧЭ, судно, груз и окружающая среда. Первостепенным и значимым элементом, находящимся на вершине холархии макроса, безусловно, является ЧЭ (судоводитель).

В зависимости от наличия и характера исходной информации (полная, неполная или ее отсутствие) судоводитель принимает субъективные решения, для которых невозможно установить единые и строгие правила. Основную роль при этом играют опыт, личные способности и умение предвидеть развитие событий. Нередким явлением в опасных условиях, ведущих к аварийным ситуациям, становится психологический стресс, и судоводители могут принять неверное решение. Таким образом, ни один из элементов судна или его подсистем не обладают достаточной надежностью и безопасностью.

Создание бортовых ИК – сложная и трудно формализуемая задача, а применение методов искусственного интеллекта в бортовых ИК для ее решения сопряжено с необходимостью учета сложнейших процессов, протекающих в изменяющемся информационном поле при отсутствии времени на принятие решений, порой в бушующей среде и меняющихся характеристиках самого судна.

При таком подходе на разработку ИК оказывают влияние достаточное количество проблем, сопряженных с разработкой искусственного интеллекта. Первая проблема - общепринятого понятия «искусственный интеллект» нет.

В своей работе судоводитель вынужден предусматривать появление непредвиденных явлений, окказиональных действий членов судового экипажа, а искусственный интеллект на это не будет реагировать никак. Таким образом, проявляется еще одна проблема создания бортовых ИК, особенно актуальная для системы управления безопасностью системой «морская среда – судно – груз – ЧЭ».

В науке нет четкого определения, в какой именно области наиболее востребован искусственный интеллект. Каждый из авторов-ученых, опираясь на свое толкование понятия, рассматривает его в свете свершений определенной научной доктрины. В силу этого предлагается один из возможных теоретических подходов для разработки основополагающих принципов теории риска и управления безопасностью (в том числе и на море) - антропоцентрический принцип, исходящий из насущной потребности человека в безопасности. Решение такой задачи предлагается на принципах самоорганизации старших по иерархии систем, где невозможно установление жесткого контроля над системой. Управление такой системой может рассматриваться лишь как способствование собственным тенденциям развития системы с учетом присущих ей элементов саморегуляции. Центральной компонентой полной функции управления является ЧЭ, опирающийся в своей деятельности на искусственный интеллект, ограниченный константой безвредности по отношению к человеку.

Нарастающие темпы внедрения и применения искусственного интеллекта почти во всех процессах развития человеческой цивилизации, и в том числе на море, незаметно привели к обострению вышеперечисленных проблем, возникающих на любом уровне. Встал вопрос о разработке философских основ интеллектуальной культуры в сфере искусственного интеллекта, ведь у человечества уже есть пример атомной бомбы.

1. Бондарев В. А., Нечаев Ю. И. Искусственный интеллект в чрезвычайных ситуациях мореплавания: моногр. СПб.: Арт-Экспресс, 2017. 336 с.

2. Нечаев Ю. И., Дегтярев А. Б., Бухановский А. В. Идентификация экстремальной ситуации в нечетких условиях: сб. докл. Международной конференции по мягким вычислениям. СПб.: Изд-во ЛЭТИ им. В. И. Ульянова (Ленина), 1998. Т. 1. С. 85–88.

3. Швырков А. И. Искусственный интеллект как философская проблема и искусственные интеллектуальные системы // Nomothetika: Философия. Социология. Право. 2022. Т. 47. № 4. С. 670–681.

4. Курпатов А. Мышление. Системное исследование. М.: Капитал, 2018. 672 с.

5. Соболев И. В., Потапова Е. А. Проблема возможности искусственного интеллекта с точки зрения психологической науки // Коллекция гуманитар. исслед. 2022. № 2 (31). С. 51–57.

6. Забоев А. А., Орлова А. И., Трапезников М. В. Проблема искусственного интеллекта и будущее человечества // Инновации. Наука. Образование. 2021. № 46. С. 2115–2119.

7. Недогарок В. В. Методы для решения проблем искусственного интеллекта // EO IPSO. 2022. № 6. С. 34–36.

8. Акентьев Д. Г., Максимов Д. И., Лысенко И. С. Проблема искусственного интеллекта и искусственного разума в жизни современного человека // Актуал. проблемы авиации и космонавтики. 2018. Т. 3. № 4 (14). С. 690–692.

9. Тимофеев А. В. Сущность и проблемы искусственного интеллекта в контексте современных научных и философских представлений // Вестн. Москов. гос. област. ун-та. Сер.: Философские науки. 2020. № 2. С. 127–133.

10. Рябинин И. А. Надежность и безопасность структурно-сложных систем. СПб.: Политехника, 2000. 248 с.

11. Каримов К. С. Основные проблемы искусственного интеллекта в науке // Постсовет. материк. 2022. № 4 (36). С. 59–66.

12. Аррыкова Г. К., Эзизова С. Э., Гараев Г. Б., Ходжакаева Д. М. Искусственный интеллект и нейронные сети: современные технологии в решении ключевых проблем // Ceteris Paribus. 2023. № 12. С. 16–18.

13. Симанков В. С., Астреин В. В. Основные методологические аспекты организации и функционирования систем поддержки принятия решений безопасности судовождения // Эксплуатация мор. трансп. 2016. № 2 (79). С. 56–64.

14. Болдина О. Б. Судовая автоматика: тенденции развития и инновационные решения // Наука. Техника. Технологии (политехн. вестн.). 2023. № 2. С. 37–39.

15. Седова Н. А. Интеллектуальная оценка степени опасности столкновения для безэкипажного судна: моногр. М.: Ай Пи Ар Медиа, 2022. 92 c.

16. Яворская Д. О., Боран-Кешишьян А. Л., Мыц Р. А., Тешнич М., Кузнецова Ю. С. Сдвиг распределения данных как одна из основных проблем внедрения искусственного интеллекта в судоходство // Эксплуатация мор. трансп. 2023. № 1 (106). С. 111–114.

17. Панченко А. Л., Панченко Т. Г., Саньков В. В. Основы Эниостиля. Базовая концепция учения о гармонии энергоинформационного общения с людьми и природой. Ижевск: Полиграфия, 1995. 60 с.

18. Смирнов А. П. Динамика реальных процессов организации и энергоинверсии // Межакад. информ. бюл. 1998. № 1-2 (8-9). С. 32–36.

19. Богданов В. А., Репьев С. И. Психоэнергетические октавы и тензоры антропогенеза // Межакад. информ. бюл. 1999. № 10-12. С. 79–81.

20. Уварова Г. Г. Механизмы парирования рисков в современной экологической политике // Гос. и муницип. упр. Учен. зап. СКАГС. 2011. № 3. С. 77–83.

21. Ходжаева Д. Ф., Омонов А. А., Тугизбоев Ф. У. Проблемы, с которыми можно столкнуться при внедрении искусственного интеллекта // Наука, техника и образование. 2021. № 5 (80). С. 23–26.

22. Дицевич Я. Б., Карнаух Д. В., Тользак А. Е. Применение искусственного интеллекта в решении экологических проблем современности // Теория государства и права. 2023. № 2 (31). С. 50–64.

23. Рябинин А. Г., Рябинин Г. А., Латухов С. В., Усачев В. В. Математическая модель функционала жизнедеятельности населения в «концепции риска» // Новости науки. 1998. № 1. С. 20.

24. Шаханова М. В., Шмыков Н. В., Шаханова Э. С. Применение систем искусственного интеллекта в сфере информационной безопасности морского судоходства // Междунар. журн. информ. технологий и энергоэффективности. 2023. № 12 (38). С. 112–115.

25. Пушкарев С. В. Проблемы правового регулирования ответственности за вред, причиненный искусственным интеллектом // Марийс. юридич. вестн. 2022. № 1 (37). С. 46–48.

26. Аксенова А. С. Правовые проблемы использования искусственного интеллекта на морском транспорте // Акад. публицистика. 2023. № 5-2. С. 360–366.